ETL

3 года назад

Nikolai Gagarinov

Ответы

Современные компании ежедневно генерируют огромные объемы информации: транзакции, логи приложений, данные пользователей, статистику продаж, результаты маркетинговых кампаний и многое другое. Чтобы превратить эту информацию в осмысленные метрики и аналитические выводы, необходимо уметь грамотно собирать, очищать, структурировать и загружать данные в специализированные хранилища. Именно эту задачу решает ETL — один из ключевых процессов индустрии обработки данных и аналитики. Сегодня ETL является неотъемлемой частью архитектуры любой развитой компании, обеспечивая связь между источниками данных и BI-системами, формируя основу для отчётности, модели данных и аналитики.

Определение и назначение ETL

Что означает ETL и в каких задачах применяется

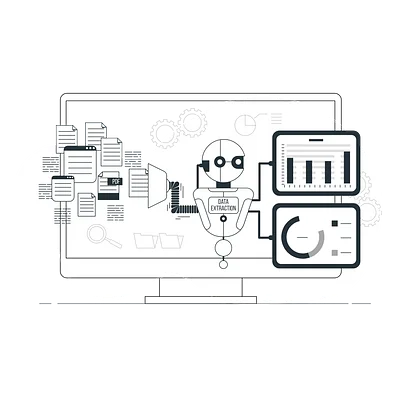

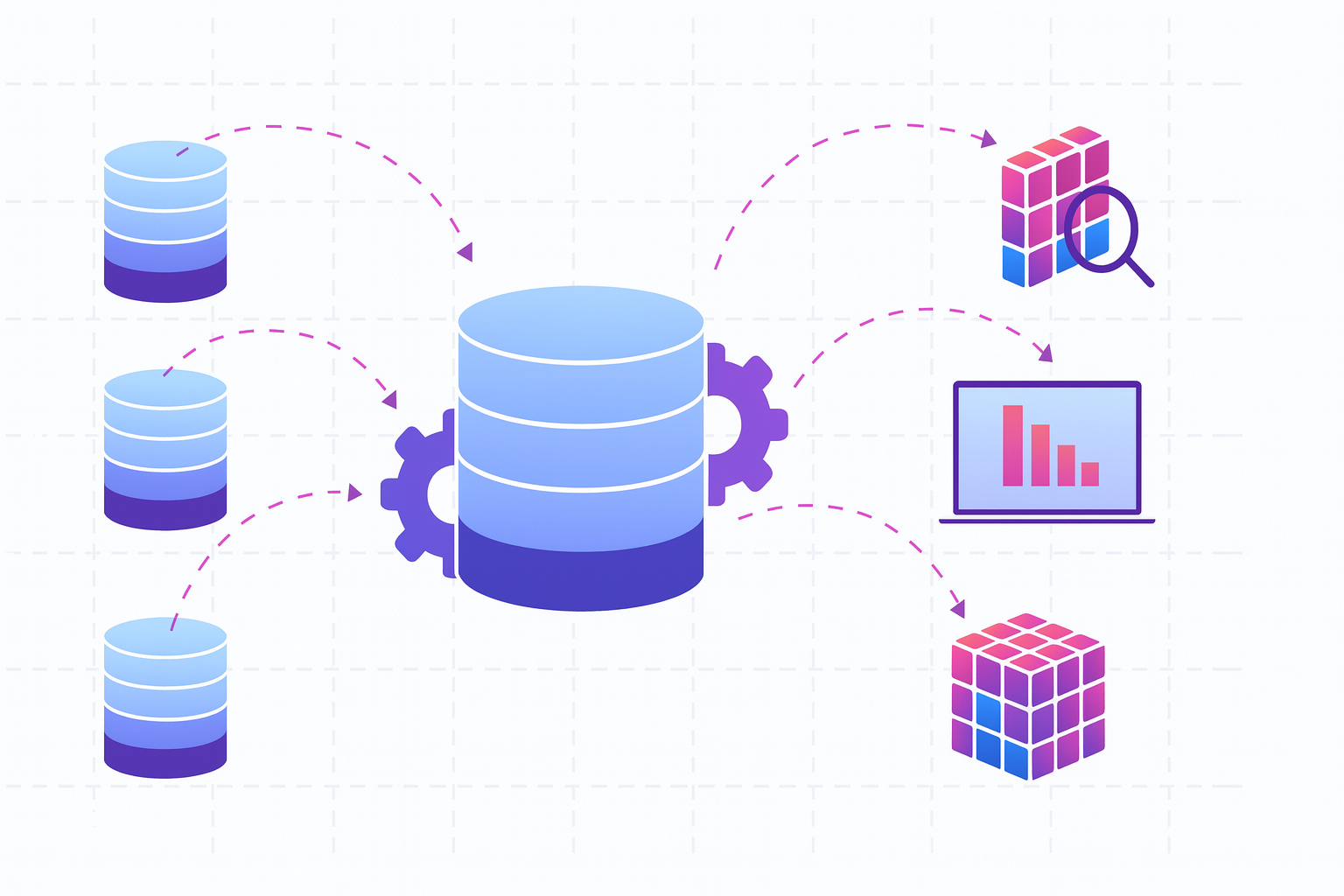

ETL — это аббревиатура трёх процессов: Extract, Transform, Load. В совокупности они образуют последовательную схему интеграции данных, целью которой является перенос информации из источников в целевые аналитические системы. На этапе Extract данные извлекаются из разнообразных систем: от традиционных реляционных баз данных до облачных API, логов, сенсорных устройств и потоковых серверов. Далее следует Transform — процесс очистки, нормализации, обогащения, агрегации и применения бизнес-правил к данным, чтобы они стали пригодными для аналитических задач. Завершает процесс этап Load, в ходе которого подготовленные данные загружаются в хранилища, витрины, lakehouses или аналитические базы.

В архитектуре BI ETL играет ключевую роль, так как именно этот процесс обеспечивает согласованность информации между разнородными системами. В обычной компании десятки или даже сотни систем: CRM, ERP, финансовые модули, сервисы логистики, веб-приложения, базы клиентов, маркетинговые платформы. Каждая хранит данные в своём формате. ETL объединяет все эти данные в единый язык, что позволяет аналитическим инструментам, таким как Power BI, Tableau, Looker или Qlik, работать с ними без ручной подготовки.

Значение ETL в корпоративной аналитике

Без корректно выстроенного ETL невозможно построить полноценную аналитику или внедрить систему управления на основе данных. Все отчеты, графики, KPI, прогнозные модели и дашборды опираются на данные, собранные и обработанные ETL-процессами. Если качество ETL низкое, бизнес получает ложную картину: отчёты становятся недостоверными, аналитика — ошибочной, а решения — рискованными. Поэтому ETL называют «кровеносной системой» аналитической инфраструктуры: он наполняет бизнес информацией и обеспечивает непрерывность ее движения.

История и эволюция ETL

От первых хранилищ данных к современным конвейерам

Понятие ETL сформировалось еще в конце XX века, когда крупные корпорации начали строить первые Data Warehouse — корпоративные хранилища данных. Тогда данные появлялись в ограниченном числе систем, и ETL был относительно прост: периодическое копирование таблиц и простейшие преобразования. Однако даже в то время стало ясно, что для стабильной аналитики необходима автоматизация, иначе ручная обработка данных не обеспечивает ни масштабируемость, ни предсказуемость.

С распространением информационных технологий и ростом количества источников данных появились новые вызовы: увеличились объёмы информации, усложнились схемы, возникла необходимость объединять данные из веб-приложений, мобильных сервисов, логов, транзакционных систем и внешних источников. Рост Big Data сделал ETL крупномасштабным процессом, требующим высокой вычислительной мощности, новых инструментов и устойчивой архитектуры.

Появление ELT и изменения подходов

Классический ETL работал годами без радикальных изменений, пока не появились облачные хранилища данных. Такие системы, как Snowflake, Google BigQuery, Amazon Redshift, ClickHouse, предложили огромную вычислительную мощность, доступную по запросу. Это позволило перенести часть трансформаций из ETL-процесса непосредственно в хранилище, что дало рождение новому подходу — ELT (Extract, Load, Transform).

Теперь данные могли загружаться в сыром виде и преобразовываться уже на стороне DWH. Это упростило архитектуру, повысило скорость разработки и уменьшило нагрузку на ETL-серверы.

Начало эпохи стриминга

К 2010-м годам стало очевидно, что пакетный ETL не справляется с задачами оперативной аналитики. Компании начали использовать решения для потоковой обработки данных: Kafka, Kafka Streams, Spark Streaming, Flink. Эти системы позволяли обрабатывать данные непрерывно, минуя задержки пакетной загрузки, и стали основой для real-time аналитики, мониторинга и динамических моделей.

Этапы ETL: расширенный разбор

Extract — извлечение данных

Этап извлечения данных стал гораздо сложнее, чем в эпоху первых хранилищ. Теперь источники могут быть:

- базы данных, работающие под высокой нагрузкой, где нельзя создавать тяжелые запросы;

- API с ограничениями на частоту запросов или объем данных;

- распределенные системы логов;

- IoT-устройства с нестабильной связью;

- data lake с разнообразными форматами файлов.

Во время Extract необходимо не только подключиться к источнику, но и обеспечить корректность данных, соблюдение временных окон, минимизацию нагрузки, поддержку механизма CDC, адаптацию к изменяющимся схемам таблиц и защиту от сетевых ошибок. В крупных компаниях Extract — это уже не просто SQL-запрос, а сложная система с журналами, триггерами, мониторингом и контролем транзакций.

Transform — ключевой этап обработки

Transform — это «сердце» ETL. Основная задача — превратить необработанные, разрозненные и иногда ошибочные данные в унифицированные и корректные. На этом этапе выполняются десятки операций, включая стандартизацию форматов, устранение шумов, интеллектуальную очистку, валидацию, связывание справочников, расчет агрегатов, обогащение внешними данными и применение бизнес-правил.

В крупных корпорациях этап Transform может включать сотни шагов и поддерживать десятки команд. Это один из сложнейших этапов, требующий аналитического мышления, знания предметной области и умения работать с большими массивами данных.

Load — загрузка в целевые хранилища

На этапе Load важна не только скорость загрузки, но и корректность обновления данных. В зависимости от архитектуры используются разные стратегии загрузки: полная перезапись таблиц, инкрементальная загрузка с вычислением дельты, upsert-операции, партиционирование и дедубликация.

Целевые хранилища могут быть распределенными системами, где неправильная стратегия загрузки приводит к ошибкам согласованности, нарушению партиций или потере данных. Поэтому этап Load требует внимательного планирования, тестирования и мониторинга.

Инструменты ETL

Talend

Talend — гибкая платформа, позволяющая визуально конструировать ETL-конвейеры. Она предоставляет сотни компонентов для подключения к источникам, трансформаций и автоматизации. Главным преимуществом Talend является сочетание простоты и мощности: он подходит и для новичков, и для крупных предприятий, которым нужна комплексная интеграция данных.

Informatica

Informatica PowerCenter десятилетиями остаётся стандартом в корпоративной среде. Она предлагает устойчивость, масштабируемость, управление качеством данных, наблюдаемость, обработку огромных массивов информации и развитую экосистему инструментов. Этот продукт применяется в банках, страховых компаниях, телеком-операторах и государственных структурах.

Apache NiFi

NiFi — мощный инструмент потоковой обработки данных, построенный на модели потоков с визуальными маршрутами. Его особенность — высокая гибкость, возможность создавать сложные сценарии маршрутизации данных и удобная работа с потоками реального времени. NiFi особенно востребован в IoT и аналитике событийных данных.

Google Dataflow

Dataflow — облачная платформа GCP, использующая модель Apache Beam. Она позволяет запускать как пакетную, так и потоковую обработку данных, автоматически масштабирует ресурсы и глубоко интегрируется с BigQuery, Pub/Sub и облачными хранилищами. Dataflow подходит для систем, требующих высокой надежности и динамического распределения вычислений.

Примеры применения ETL

Построение аналитической экосистемы

В любой компании с развитой BI-инфраструктурой ETL используется для наполнения хранилища данных. С его помощью объединяются данные о продажах, финансах, маркетинге, клиентах и операциях. Это позволяет менеджерам видеть реальную картину бизнеса и принимать стратегические решения.

Миграции данных

При переходе с одной платформы на другую ETL обеспечивает корректное преобразование схем, перенос исторических данных, выравнивание типов и устранение несовместимостей.

Обновление отчетности

Все KPI, финансовые отчеты, ежедневные метрики, дашборды руководителей — результат ежедневной или ежечасной работы ETL-процессов.

Подготовка данных для моделей машинного обучения

ML-модели требуют чистых, структурированных и корректных данных. ETL автоматизирует подготовку признаков (feature engineering), объединяет данные из разных источников и обеспечивает стабильный поток данных для обучения моделей.

Проблемы и сложности в ETL

Сложность обеспечения качества данных

Ошибка на раннем этапе может привести к неправильным отчётам, нарушению работы моделей и проблемам с бизнес-решениями. Отслеживание качества данных требует тщательных проверок, логирования, правил валидации и автоматических алертов.

Задержки пакетной обработки

Пакетный ETL может создавать существенные задержки: если процесс идёт раз в сутки, данные будут устаревшими. Для некоторых задач это критично — например, для финансовых транзакций, анализа пользовательского поведения или динамической оптимизации.

Масштабирование при росте данных

Когда объем данных растет, ETL-процесс может перестать укладываться в доступное время. Инженерам приходится оптимизировать архитектуру, переходить на распределённые системы или комбинировать batch и streaming-подходы.

Сложность отладки

ETL-пайплайн может включать сотни шагов, и найти ошибку в цепочке бывает трудно. Необходимо иметь продуманный мониторинг, тесты, версии пайплайнов и механизмы отката.

Альтернативы ETL: ELT и потоковая обработка

Когда выбирать ELT

ELT идеален для облачных DWH, где вычисления стоят дёшево, а параллельность — огромная. Он позволяет быстро загружать данные и выполнять преобразования средствами SQL-движка, что значительно ускоряет разработку и уменьшает сложность конвейера.

Потоковые решения

Streaming-подход необходим, когда данные должны обрабатываться мгновенно. Kafka, Flink и Spark Streaming позволяют создавать реальное «текущее» состояние данных, обрабатывать события с миллисекундной задержкой и строить сложные системы realtime-аналитики, мониторинга или реактивных сервисов.

Современные тенденции ETL

Переход к микросервисным архитектурам

Крупные ETL-монолиты уступают место микрокомпонентам, которые легче развивать и масштабировать. Архитектуры на основе Kafka или Pub/Sub позволяют строить гибкие, отказоустойчивые системы.

Облачные ETL-платформы

Сервисы уровня AWS Glue, Azure Data Factory и Google Dataflow снижают необходимость в собственной инфраструктуре и предоставляют автоматическое масштабирование.

Интеллектуальная автоматизация

Инструменты нового поколения включают автоматическую генерацию схем, обнаружение ошибок, контроль качества данных и Data Observability, что снижает риск сбоев и повышает прозрачность процессов.

5 месяцев назад

Nikolai Gagarinov

ETL (Extract, Transform, Load) - это процесс обработки данных, который включает в себя извлечение данных из различных источников, их преобразование и очистку, а затем загрузку в целевую систему. ETL-процесс используется для интеграции данных из разных источников, таких как базы данных, файлы, API и другие, и преобразования их в формат, который может быть использован для анализа. ETL-инструменты помогают автоматизировать этот процесс и обеспечивают управление качеством данных.

3 года назад

Елена Редькина