LRU

3 года назад

Nikolai Gagarinov

Ответы

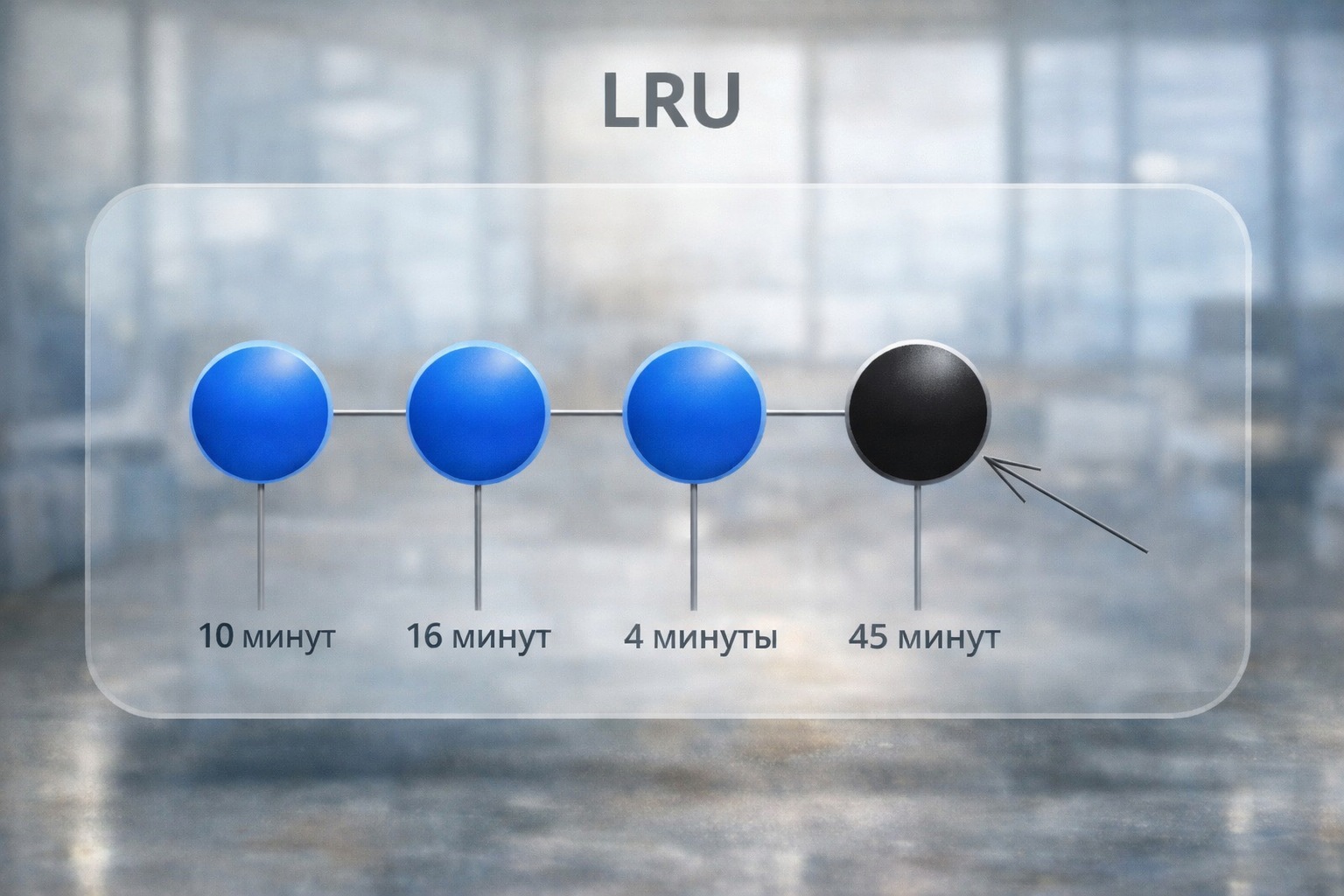

LRU — это алгоритм вытеснения данных, основанный на принципе «давно не использовалось — удалить первым». LRU применяется в системах, где объём кэша ограничен, а скорость доступа к часто используемой информации критична. Алгоритм отслеживает время последнего обращения к элементу и сохраняет в кэше только те записи, которые использовались недавно. Всё, к чему обращались давно, вытесняется при заполнении доступного пространства.

LRU используется в кэширующих подсистемах приложений, браузеров, операционных систем, веб-сервисов и других программных компонентов, где важно минимизировать задержки при получении данных. Механизм опирается на наблюдение: если объект использовали недавно, высокая вероятность, что он понадобится снова в ближайшее время.

Где используется LRU

Алгоритм подходит для широкого спектра сценариев:

-

кэширование запросов в веб-приложениях;

-

хранение промежуточных расчётов в аналитических системах;

-

управление кэшем в файловых системах;

-

оптимизация работы браузеров и графических движков;

-

организация локального кэша в сторонних библиотеках и фреймворках.

LRU применяют тогда, когда система активно обращается к ограниченному набору данных и важно оперативно выдавать результат без повторных вычислений или обращений к диску или сети.

Однако LRU непредпочтителен в задачах с равномерными периодическими обращениями, где каждый элемент запрашивается раз в фиксированный интервал времени. В таких схемах «давно не использовался» не означает «не нужен», что приводит к постоянному вытеснению данных, которые вскоре снова потребуются.

Принцип работы алгоритма LRU

Чтобы реализовать механизм, система должна уметь:

-

хранить элементы кэша;

-

фиксировать момент последнего обращения к каждому элементу;

-

быстро находить и удалять запись с самой старой меткой времени.

Общий порядок работы выглядит так:

-

При обращении к данным система проверяет, присутствуют ли они в кэше.

-

Если данные найдены, алгоритм обновляет их временную метку.

-

Если данных нет, происходит добавление элемента в кэш.

-

Пока объём кэша не исчерпан, новые значения записываются без вытеснения.

-

Если кэш заполнен, алгоритм находит элемент с минимальной временной меткой.

-

Объект с наименьшим приоритетом удаляется, освобождая место для нового.

Размер кэша обычно фиксируют двумя способами:

-

ограничение количества элементов;

-

ограничение выделенной памяти.

Отличие LRU от FIFO

Хотя оба алгоритма обеспечивают автоматическое вытеснение данных, их логика различается:

Таким образом, FIFO оперирует фактом «появился давно», а LRU — фактом «не использовался давно».

Преимущества LRU

Алгоритм получил широкое распространение благодаря нескольким свойствам:

-

предсказуемая модель вытеснения;

-

стабильный объём использования памяти;

-

высокая скорость доступа при корректной реализации;

-

адаптивность к реальным паттернам поведения пользователя.

Эти характеристики делают LRU подходящим решением для большинства прикладных кэширующих задач.

Недостатки LRU

Несмотря на удобство, алгоритм обладает ограничениями:

-

неэффективен при циклических обращениях со всплесками редких повторов;

-

требует постоянного обновления временных меток;

-

предполагает хранение дополнительной служебной информации;

-

может приводить к избыточной активности структуры данных при высокой частоте запросов.

Эти ограничения учитываются при выборе политики кэширования.

Структуры данных для LRU

Стандартная схема реализации сочетает две структуры:

-

Хеш-таблица Используется для быстрого поиска элемента по ключу.

-

Двусвязный список Хранит порядок приоритетов:

-

голова списка — самый недавно использованный элемент;

-

хвост — самый «старый» и кандидат на удаление.

-

При каждом обращении к элементу узел перемещается в голову списка. При добавлении нового элемента и переполнении кэша удаляется хвостовой узел.

Пример реализации LRU (Python)

Ниже приведён классический вариант кэша фиксированной ёмкости:

Этот пример демонстрирует базовую логику: обновление порядка при обращении и удаление наименее используемого элемента при переполнении.

Почему LRU остаётся востребованным

Несмотря на появление модификаций (LFU, ARC, 2Q и др.), LRU сохраняет популярность благодаря простоте и надёжности. Он хорошо масштабируется и предсказуемо работает в условиях, где частота запросов имеет локальные повторения.

Ключевые причины востребованности:

-

минимальная когнитивная сложность алгоритма;

-

прозрачность поведения при анализе производительности;

-

возможность реализации практически на любом языке программирования;

-

совместимость с требованиями широкого класса приложений.

3 месяца назад

Nikolai Gagarinov

LRU (Least Recently Used) - это алгоритм управления памятью, который удаляет из памяти те объекты, к которым дольше всего не было обращений. Это позволяет оптимизировать использование памяти, удаляя неиспользуемые объекты и сохраняя наиболее часто используемые. Алгоритм LRU особенно полезен в системах с ограниченным объемом памяти, таких как веб-серверы и мобильные устройства.

3 года назад

Елена Редькина