Лучшие ИИ для кодинга в 2026: модели, IDE, агенты и бесплатные варианты

Когда человек гуглит «лучшие ИИ для кодинга», в голове у него обычно сидит ровно одно желание: чтобы кто-то прислал название и инструкцию. Желание понятное, но реальность так не работает. Выбор всегда состоит из трёх частей: какая модель пишет код, в какой оболочке вы её используете (чат в браузере, редактор, командная строка) и какие данные провайдеру разрешено увидеть.

Дальше — разбор по каждой из этих частей. Без вранья про «самую лучшую» модель, потому что её нет. С таблицами под конкретные задачи, реальными лимитами бесплатных тарифов и протоколом, как за две недели выбрать стек для команды.

Сразу оговорюсь по датам. Названия моделей и тарифы меняются раз в несколько недель. Любая статья в духе «модель X — №1 навсегда» устаревает за месяц. Здесь — снимок на апрель 2026 года, и ниже расскажу, как пересобирать стек, не залипая в новостях каждый день.

Чтобы поток ИИ-кода не превращался в технический долг быстрее, чем вы успеваете его читать, нужен процесс. Программа «ИИ для разработчиков» на Хекслете как раз про это: агенты, контекст, ревью, границы ответственности.

Что на самом деле прячется за словом «лучший»

Слово «лучший» — это запрос на готовый ответ. У разработчика обычно есть пять рабочих критериев, и они не сводятся к одной цифре в бенчмарке:

Корректность кода. Заработает ли это с первой попытки или придётся отлавливать баги полчаса

Соответствие стилю репозитория. Совпадает ли по нэймингу, паттернам, структуре с тем, что уже написано

Предсказуемость дифа. Один и тот же запрос через неделю даст такой же результат или совсем другой

Стоимость проверки. Сколько времени вы потратите на ревью того, что вам сгенерировало

Цена в деньгах. Сколько долларов в месяц с учётом всех ваших задач

Любая модель сильна по одним критериям и слаба по другим. «Лучшая» — это та, у которой профиль сильных сторон совпадает с вашими задачами. Поэтому начнём с задач, а не с моделей.

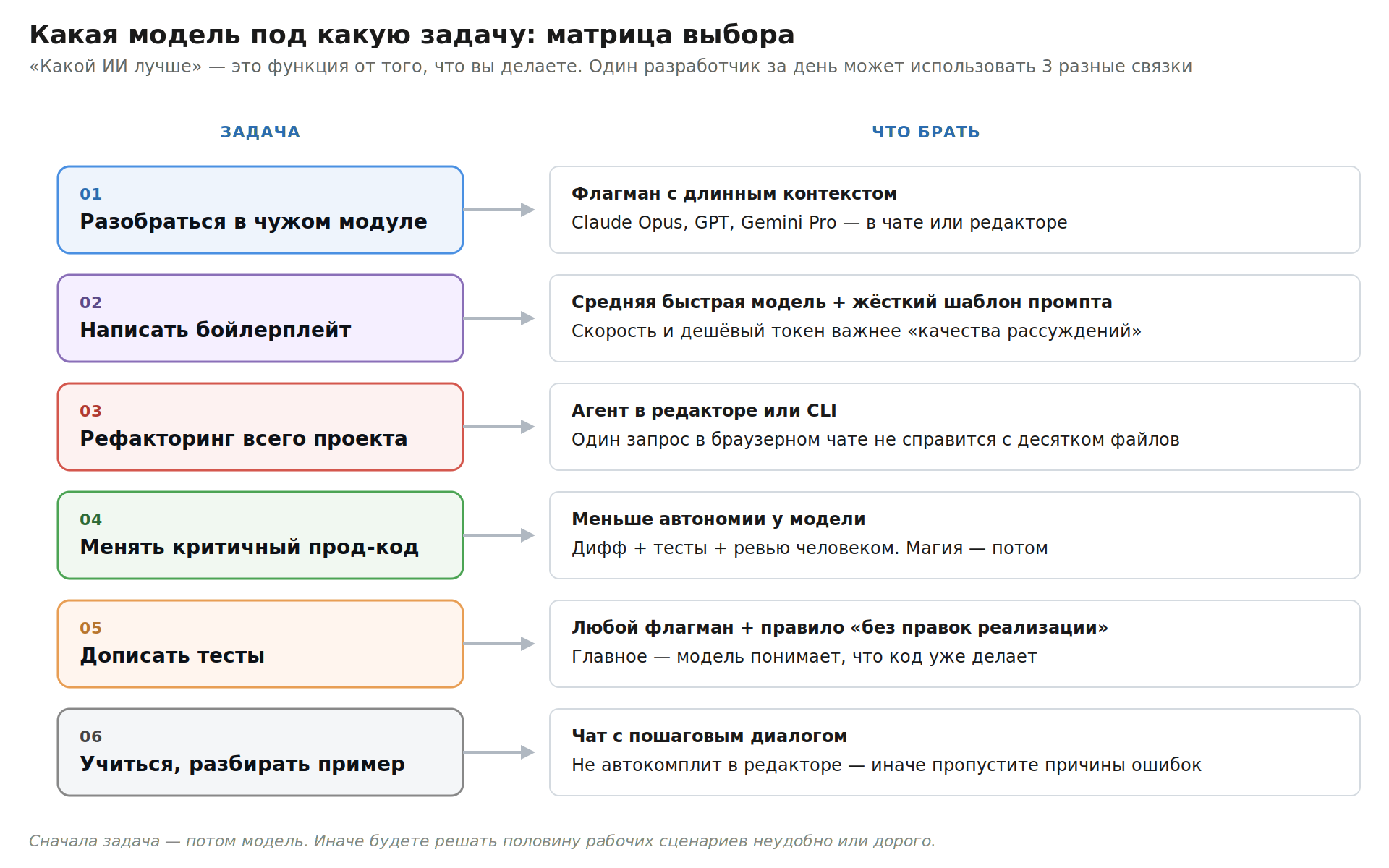

Сначала задача, потом модель

Если зайти с противоположного конца — взять модель из топ-рейтинга и попробовать решить ей всё подряд — окажется, что половина задач решается ей неудобно или дорого. Перевернём логику:

Что вы делаете | Что важнее всего | Куда смотреть |

|---|---|---|

Разбираетесь в чужом модуле | Длинный контекст, рассуждения | Флагман (Claude Opus, GPT, Gemini Pro) в чате или редакторе |

Пишете бойлерплейт | Скорость и дешёвый токен | Средняя быстрая модель плюс жёсткий шаблон промпта |

Делаете рефакторинг по всему проекту | Целостность изменений в десятке файлов | Агент в редакторе или CLI, а не один запрос в браузере |

Меняете критичный продакшен-код | Воспроизводимость, минимум магии | Меньше автономии у модели: дифф плюс тесты плюс ревью человеком |

Дописываете тесты к существующему коду | Понимание того, что код уже делает | Любой флагман плюс правило «без правок самой реализации» |

Учитесь, разбираете чужой пример | Объяснения, причины ошибок | Чат с пошаговым диалогом, а не автокомплит в редакторе |

Вывод простой: «какой ИИ лучше» — это функция от того, что вы делаете. Один и тот же человек за один рабочий день может использовать три разные связки.

Шортлист моделей на апрель 2026

Не «топ навсегда», а рабочая отправная точка. Если нужен быстрый старт без недельного ресёрча — начинайте отсюда.

Модель / семейство | В чём сильна | Где проседает | Когда брать первой |

|---|---|---|---|

Claude (Sonnet, Opus) | Длинные правки кода, аккуратный рефакторинг, понятные объяснения | Дороже средних моделей | Сложный PR, много контекста |

GPT (актуальные coding-модели) | Стабильный универсал, много интеграций | На длинных сессиях деньги набегают быстро | Повседневная разработка в редакторе или с агентом |

Gemini (Pro-линейки) | Скорость, широкое контекстное окно, интеграция с Google-инфрой | Качество скачет по типам задач | Mixed-стек, активная работа в инфраструктуре Google |

Qwen Coder | Сильный локальный и гибридный сценарий, хорошая цена за качество | Нужно подбирать размер и квантизацию под железо | Локальный запуск, on-prem |

DeepSeek Coder | Сильный кодоген на рутине и алгоритмах | Может ломаться на больших рефакторингах | Бойлерплейт, типовые задачи |

Llama (code, instruct) | Понятный локальный контур и большая экосистема | На малых размерах точность проседает | Офлайн и строгий ИБ-режим |

Mistral (code-friendly) | Быстрые ответы, удобна как рабочая лошадка | Хуже держит сложный многошаговый ремонт | Черновики, скрипты, утилиты |

Если совсем коротко:

Нужно качество — Claude, GPT или Gemini

Нужен локальный контур — Qwen, DeepSeek, Llama, Mistral

Нужен дешёвый поток задач — средние модели плюс хороший шаблон промпта

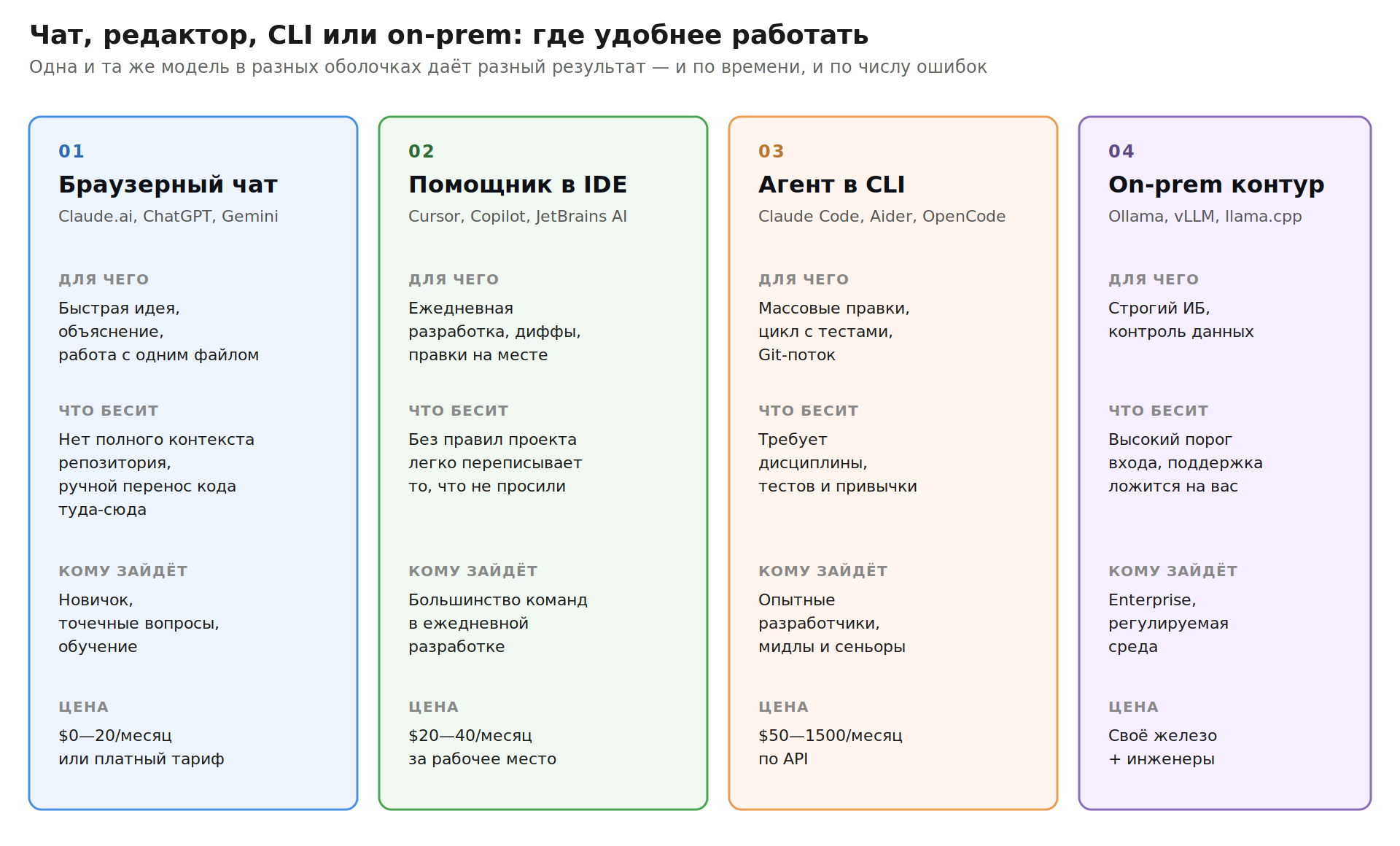

Где удобнее работать: чат, редактор или CLI

Самая частая ошибка при выборе ИИ — думать про модель и забывать про оболочку. На практике одна и та же модель в браузерном чате и в редакторе даёт разный результат — и по времени, и по числу ошибок.

Оболочка | Для чего удобна | Что бесит | Кому зайдёт |

|---|---|---|---|

Браузерный чат (Claude.ai, ChatGPT, Gemini) | Быстрая идея, объяснение, работа с одним файлом | Нет полного контекста репозитория, ручной перенос кода туда-сюда | Новичок, точечные вопросы, обучение |

Помощник в редакторе (Cursor, Copilot, JetBrains AI) | Ежедневная разработка, диффы, правки на месте | Без правил проекта легко переписывает то, что не просили | Большинство команд |

Агент в CLI (Claude Code, Aider, OpenCode) | Массовые правки, цикл с тестами, Git-поток | Требует дисциплины, нормальных тестов и привычки | Опытные разработчики |

Свой on-prem контур | Строгий ИБ и контроль данных | Высокий порог входа, поддержка ложится на вас | Enterprise, регулируемая среда |

Как сравнивать модели без иллюзий

Если тестировать «на глаз», любая новая модель кажется лучше старой — потому что вы под впечатлением и подсознательно даёте ей задачи попроще. Нужен короткий, но жёсткий протокол.

Возьмите 10 одинаковых задач из своей реальной работы. Фикс бага, дописать тест, рефакторинг функции, миграция, добавление новой функциональности в существующий модуль. Лучше всего — задачи, которые вы уже сделали руками, чтобы было с чем сравнивать

Зафиксируйте одинаковый шаблон промпта. Одна и та же роль, одни и те же входные данные, один и тот же формат ожидаемого ответа

Меряйте три метрики, а не «красоту ответа». Время до рабочего PR, число ручных правок после генерации, количество падений тестов или линтера после первого запуска

Считайте полную стоимость. Токены плюс время разработчика на проверку. Часто оказывается, что «дешёвая» модель выходит дороже из-за того, что вы дольше её правите

После такого прогона обычно выясняется простая штука: в вашем процессе побеждает не самая умная модель, а та, после которой меньше ручной доработки.

Десять приёмов, которые экономят больше всего времени

Это сводка того, что повторяется у команд, которые год-полтора уже работают с ИИ в проде. Никакой магии — банальная гигиена процесса.

Приём | Что делать | Что это даёт |

|---|---|---|

Сначала план, потом код | Отдельный шаг планирования. Утверждаете план — только потом разрешаете писать код | Меньше хаотичных правок и откатов |

Прогрев контекста сверху вниз | Сначала архитектура и подсистемы, потом конкретный модуль | Меньше «пальбы по 500-й строке» в файле, который агент не видит целиком |

Один агент — одна задача | Не мешайте фиксы, рефакторинг и тесты в одном заходе | Стабильнее результат, проще ревью |

План в .md-файле | Храните план как артефакт в репозитории, сверяйте реализацию по пунктам | Меньше недоделок «почти готово» |

Тесты как критерий приёмки | Просите код плюс проверку: unit, integration, e2e — что подходит под задачу | Качество видно до ревью |

Чек-листы-гейты | После генерации прогоняйте список: архитектура, стиль, покрытие, безопасность | Снижает типовые ошибки |

Маленькие коммиты по шагам | Коммит после каждого логического шага | Откат одной командой вместо разгребания |

Сброс контекста между этапами | После завершённого шага рестарт с чистым контекстом и нужными файлами | Меньше накопленных галлюцинаций |

Жёсткая структура промпта | Роль, цель, входные данные, ограничения, формат ответа | Меньше воды, больше воспроизводимости |

Верификация по плану | По пунктам: сделано / не сделано, какой файл, какой тест | Ловит пропущенные части задачи |

Антипаттерны, которые ломают результат чаще всего

Антипаттерн | Чем заканчивается | Чем заменить |

|---|---|---|

«Сделай красиво, как лучше» | Непредсказуемый дифф, спор на ревью | Конкретная цель плюс ограничение по списку файлов |

Большой дифф в одном коммите | Высокий шанс пропустить баг | Серия маленьких коммитов и шагов |

Агент без тестов | «Вроде работает» — до первого реального пользователя | Тесты как часть Definition of Done |

Длинная сессия без сброса контекста | Деградация качества к концу — модель забывает, с чего начинала | Короткие итерации, рестарт контекста между этапами |

Оценка «по ощущениям» | Вечный спор «какая модель лучше» | Метрики: время, правки, падения тестов, цена |

Когда облако удобнее, а когда нет

В облаке почти всегда модели свежее, не нужно возиться с GPU, проще интеграции с GitHub Copilot, JetBrains AI и встроенными помощниками Cursor, VS Code и подобных инструментов.

Минусы стандартные. Данные уходят провайдеру — внимательно читайте DPA (data processing agreement) и настройки телеметрии. Есть лимиты на токены и запросы. Есть цена. Иногда есть геоблок или корпоративный запрет на внешние модели.

Практический вывод: облако удобно там, где скорость важнее полного контроля над данными. Локалка — где контроль важнее скорости.

Что бесплатно на самом деле

«Бесплатный ИИ для кодинга» — словосочетание со звёздочкой. Совсем без денег работают три варианта:

Вариант | Сколько стоит | В чём подвох | Где использовать |

|---|---|---|---|

Бесплатный тариф провайдера | 0 рублей | Лимиты на сообщения, очереди, иногда урезанная модель | Учёба, разовые задачи, прототипы |

Локальная маленькая модель (7B–14B) | 0 рублей за API | Качество и контекст ограничены вашим железом | Офлайн-черновики, эксперименты |

Open-source плагин плюс свой API-ключ | Платите только по токенам | Нужно следить за расходами руками | Аккуратная командная эксплуатация |

Бесплатный слой подходит для учёбы и прототипов. Для ежедневной командной работы платный тариф обычно окупается за пару недель — за счёт скорости, отсутствия очередей и доступа к флагманам.

Когда нужен локальный запуск

Локальная модель имеет смысл в трёх ситуациях:

Политика компании запрещает вынос кода наружу

Нужна стабильная работа в офлайн или в плохой сети

Команда готова держать качество сама: квантизация, RAM и VRAM, обновления, профили под разные задачи

Типичный стек: Ollama, LM Studio, llama.cpp плюс семейства Qwen, Llama, Mistral, DeepSeek в code-вариантах. Размер модели подбирается под железо.

Класс модели | Примеры | На чём работает | Под какие задачи |

|---|---|---|---|

7B–8B (квантизованные) | Qwen, Llama, Mistral small | Ноутбук без топовой GPU | Автодополнение, мелкие фиксы |

14B–16B | Qwen Coder, DeepSeek Coder mid | Мощный ноутбук или desktop с GPU | Сервисный код, тесты, рефакторинг модулей |

30B и больше | Старшие code-варианты семейств | Рабочая станция и выше | Сложные миграции, длинные цепочки правок |

Правило простое: лучше маленькая модель, которая стабильно отвечает за две секунды, чем большая, которая «думает» минуту и всё равно ломает тесты.

Вайб-кодинг без боли

Когда люди ищут «лучший ИИ для вайб-кодинга», обычно имеют в виду минимум трения: идея — черновик — правки — откат через Git. Здесь критична не абсолютная мощность модели, а среда вокруг неё.

Что должно работать как часы:

Индекс репозитория и нормальный поиск по коду

Встроенный дифф и быстрый reject правок

Правила проекта (линтер, форматтер, CI), чтобы поток не разваливал прод

Про правила в редакторе — в материале «Cursor Rules — как писать правила, чтобы они работали». Если вы только разбираетесь, что вообще такое вайб-кодинг — у нас есть отдельный обзор главных событий года.

Когда нужен агент, а когда не надо

«Лучший ИИ-агент для кодинга» — это не модель из топа рейтинга. Это связка: модель плюс инструменты (файлы, терминал, тесты) плюс ограничения (что агенту разрешено менять).

Агент полезен, когда нужно несколько шагов и реакция на среду: запустил тесты, увидел падение, исправил, прогнал снова. Такой режим дороже по токенам и вниманию, но экономит часы на рутине.

Базовые ограничения, которые стоит включать сразу с первого запуска:

Не трогать миграции и инфраструктурные конфиги без явного разрешения

Менять не больше N файлов за один шаг

После каждого шага печатать список изменённых файлов и команду для проверки

Подробный годовой опыт работы с агентами в проде — в статье «Год разработки с ИИ-агентами».

Если вы пишете на Python

На Python флагманские модели уверенно пишут Django, FastAPI и pytest. Проблема в другом: они так же уверенно предлагают устаревший API или паттерн, который не принят в вашей команде.

Что помогает на практике:

Зафиксировать версию Python и инструменты (ruff, mypy, pytest) в pyproject.toml

Держать в репозитории два-три эталонных примера: сервис, миграция, обработчик. Модель будет на них опираться

Просить вернуть патч с тестом, а не «идею без проверки»

Подзадача | Что запускать первым | Что проверить руками |

|---|---|---|

CRUD-эндпоинт на FastAPI | Флагман в редакторе | Валидация схем, обработка ошибок |

pytest и фикстуры | Средняя быстрая модель | Изоляция тестов, риски флэйковости |

Миграции и ORM | Флагман или агент с ограничениями | Идемпотентность, rollback, индексы |

Async-код и очереди | Флагман с длинным контекстом | Race conditions, таймауты |

Системно выстроить путь в язык поможет профессия «Python-разработчик» на Хекслете.

Почему «самого лучшего» не существует

Запрос «самый лучший ИИ для кодинга» понятен — все хотят снять неопределённость одним выбором на год. На практике одного победителя нет, и вот почему.

Лучшим оказывается тот ИИ, у которого совпали: ваша задача + ваш репозиторий + ваша политика данных + ваш бюджет. Поменяйте одно из четырёх — изменится и победитель. Поэтому формулировку «лучший ИИ для кодинга 2026» полезно читать как «нужен актуальный срез», а не как «один выбор, который теперь со мной до пенсии».

Рабочая частота пересмотра стека — раз в квартал. Раз в три месяца тратите половину дня, прогоняете десять задач на двух-трёх связках, делаете вывод. Не каждую неделю и не раз в год.

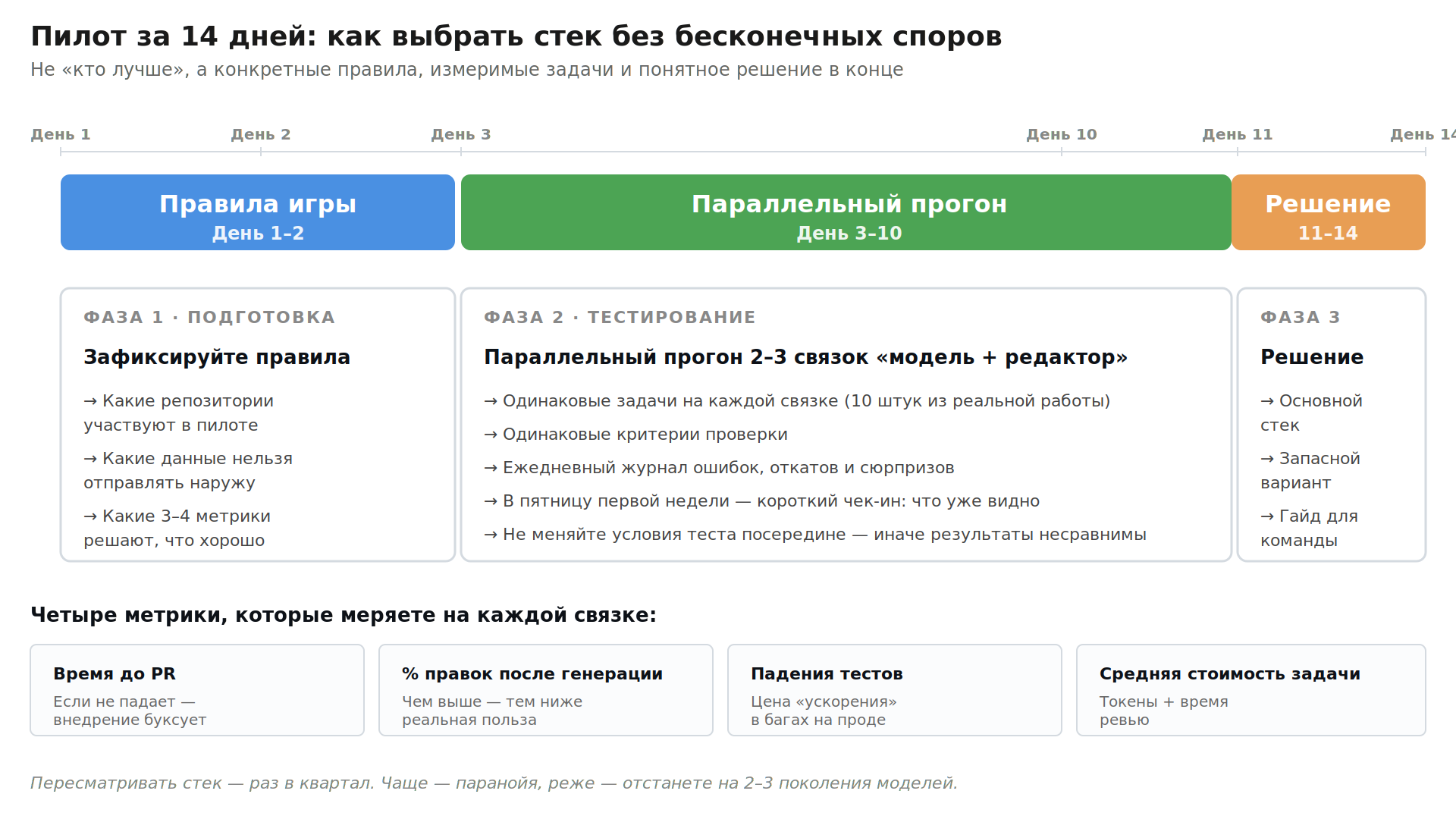

Как выбрать стек за две недели

Если вы внедряете ИИ в команде, не устраивайте бесконечный спор «кто лучше». Сделайте короткий пилот.

Когда | Что делаете |

|---|---|

День 1–2 | Фиксируете правила: какие репозитории участвуют, какие данные нельзя отправлять наружу, как измеряете успех |

День 3–10 | Параллельный прогон 2–3 связок (модель + редактор/агент) на одинаковых задачах с одинаковыми критериями. Ведёте журнал ошибок и откатов |

День 11–14 | Выбираете основной стек, описываете запасной вариант на случай аварии, публикуете короткий гайд для команды |

Минимальный набор метрик пилота:

Метрика | Как читать |

|---|---|

Время до PR | Если не падает по сравнению с ручной работой — внедрение буксует |

Доля правок после генерации | Чем выше, тем ниже реальная польза |

Падения тестов с первой попытки | Показывает цену «ускорения» |

Средняя стоимость задачи | Токены плюс время на ревью |

Что пробовать в разных сценариях

Сценарий | С чего начать |

|---|---|

Ежедневная работа в команде, облако разрешено | GPT, Claude или Gemini в редакторе плюс политика секретов |

Нужен бесплатный старт | Бесплатный облачный лимит плюс локальная Qwen или DeepSeek 7B–14B |

Строгий ИБ-контур | Qwen, Llama или Mistral локально через Ollama или on-prem |

Быстрый прототип UI или скриптов | Быстрая средняя модель в редакторе, коммиты по одной задаче |

Большой рефакторинг | Флагман плюс агентный цикл плюс тесты на каждом шаге |

Безопасность и комплаенс

Главное правило: в промпты не отправляются ключи, пароли и персональные данные. Никогда. Добавьте защиту секретов и .env в правила проекта и в .gitignore.

Для облачных сервисов проверьте две вещи. Первое — какие данные провайдер использует для обучения (хорошие провайдеры дают опцию выключить эту опцию для платных тарифов). Второе — где физически хранятся логи и сколько времени их держат.

Деньги, тарифы, корпоративные планы и окупаемость подписок — в отдельной статье про подписки на AI для разработчика.

Частые вопросы

Можно ли назвать одного лидера среди ИИ для кодинга?

Для маркетинга — да, всегда найдётся. Для разработки полезнее матрица: задача × политика данных × бюджет. В этой матрице у разных строк разные победители.

Какой бесплатный ИИ для кодинга лучше?

Тот, чей бесплатный лимит покрывает ваш рабочий ритм и не режет контекст проекта. Часто работает связка «локальная маленькая модель плюс платный облачный флагман для сложных задач» — суммарно дешевле, чем один платный тариф на всё.

Какой ИИ выбрать новичку?

Тот, где вы видите причины ошибок — редактор с тестами, линтером и понятным диффом. Иначе легко начать копировать неверные ответы и не заметить.

Для вайб-кодинга лучше чат или редактор?

Для кода — редактор. Меньше переключений, быстрее проверка, удобный откат через Git.

Какая локальная модель лучше для слабого компьютера?

Квантизованная маленькая модель под узкие задачи. Не ждите от неё качества облачного флагмана — это разные весовые категории. На ноутбуке без отдельной GPU реально работают версии на 7–8 миллиардов параметров с квантизацией Q4.

Когда агент действительно нужен, а когда хватает обычного помощника?

Когда ручной цикл по десяти-пятнадцати файлам с запуском тестов начинает стоить дороже, чем настройка агента и ревью его дифа. Если задача укладывается в один-два файла — обычный помощник в редакторе быстрее.

Какая модель лучше для Python в продакшене?

В продакшене решает не название модели, а ваш CI, типизация, тесты и культура ревью. Любая флагманская модель пишет рабочий Python — вопрос в том, как этот Python потом доходит до боевой эксплуатации.

Как часто пересматривать выбор стека?

Раз в квартал — оптимально. Раз в неделю — паранойя и бесконечные споры в команде. Раз в год — пропустите два-три поколения моделей. Раз в три месяца — успеете заметить значимые изменения, но не утомитесь от постоянной миграции.

.png)